Ein Gespräch mit Nivine El-Aawar.

Stefan: Luke Munn schreibt Algorithmen verfügen über eine politische Qualität. Erst einmal erzeugt, gestalten sie von selbst unsere politischen Agenden mit. Virginia Eubanks zeigt in ihrer Studie „Automating Inequality“, wie Algorithmen im Versicherungswesen in den USA eine diskriminierende und Armut verstärkende Wirkung haben. Sie fürchtet, dass die damit verbundenen Mechanismen des „red flagging“ Arme kriminalisieren und digitale Armenhäuser erzeugen könnte.

Nivine: Dem würde ich zustimmen. Algorithmen reproduzieren soziale Ungleichheiten. Dies ist der Fall, da personenbezogene Daten verarbeitet werden, welche die Interessen und Vorlieben der Nutzer*innen darstellen. Im Sinne von Bourdieu spiegeln diese den Habitus wider, welcher die soziale Position von Individuen darstellt. Wenn nun also quasi ein „digitaler Habitus“ von Algorithmen in Form von digitalen Nutzer*innenprofilen kreiert wird und dann genutzt wird, um Inhalte, wie Videos, personalisierte Werbeanzeigen, Nachrichten etc. zu kuratieren, können Algorithmen soziale Ungleichheiten nicht nur reproduzieren, sondern diese auch verstärken.

Ela: Eine Studie von 2020 (Silvia Milano, Mariarosaria Taddeo & Luciano Floridi) mit dem Titel „Recommender systems and their ethical challenges“ hat sich mit einigen Problemen im Zusammenhang mit Algorithmen befasst. Wie du bereits gesagt hast: Wenn die Klassifizierung durch den Algorithmus für die Erstellung der Nutzermodelle auf Grundlage der gesammelten Nutzerdaten basiert, werden soziale Kategorien reproduziert.

Außerdem sind Empfehlungssysteme im Zusammenhang mit Nachrichten und sozialen Medien so konzipiert, dass Nutzer*innen in ihren Filterblasen „gehalten“ werden, also sie kommen gar nicht dazu sich mit anderen Standpunkten auseinandersetzen zu müssen, sondern werden geradezu mit immer ähnlichem Content und gleichartigen Meinungen zugespammt. Bereits vorhandene Vorurteile werden dadurch verstärkt.

Zudem sind solche Algorithmen für politische Manipulation anfällig, da besonders aktive Nutzer*innen bzw. jene mit einer besonders großen Anzahl an Follower*innen die öffentliche Meinung beeinflussen können, indem sie starke positive Rückkopplungen im System erzeugen – was dazu führt, dass ihr Content besonders häufig empfohlen wird.

YouTube arbeitet ja auch so. Der ehemalige YouTube-Mitarbeiter Guillaume Chaslot hat eine Software geschrieben, um einen Einblick in die Empfehlungsmaschinerie von YouTube zu geben. Sie simuliert das Nutzer*innenverhalten und zeichnet Daten darüber auf, welche Videos von YouTube empfohlen werden, um im Endeffekt die „Vorlieben“ des Algorithmus abzubilden. Chaslots Untersuchungen legen nahe, dass YouTube systematisch Videos vorschlägt, die polarisierend, sensationslüstern und verschwörerisch sind.

Die Soziologin Zeynep Kufekci geht davon aus, dass YouTube mit Verschwörungscontent seinem Ziel der Verlängerung der Verweildauer seiner Nutzer*innen effizienter näherkommt, weshalb der Algorithmus solchen Content bevorzugt. „Die Frage“, so Kufekci, sei „ob es ethisch vertretbar“ sei, dies auch zu tun, „nur weil es funktioniert“.

Ähnliches hat die Facebook-Whistleblowerin Frances Haugen 2021 über die Social Media Plattformen Instagram und Facebook verlauten lassen. 2017 hat Facebook eine Arbeitsgruppe ins Leben gerufen, um herauszufinden, ob die Maximierung der Nutzer*innenaktivität zur politischen Polarisierung beiträgt. Man kam zum Ergebnis, dass es einen Zusammenhang gebe, aber eine Verringerung der Polarisierung hätte einen Rückgang des Nutzer*innen-Engagements bedeutet. Lösungen wie die Optimierung der Empfehlungsalgorithmen stellten sich als „wachstumsfeindlich“ heraus und wurden nicht weiterverfolgt.

Stefan: Rebecca Giblin und Cory Doctorow schreiben, dass der Online-Werbemarkt ein Betrugskonzept ist. Denn was schließlich darüber entscheidet, ob etwas überhaupt gesehen wird, ist nicht die Werbung, sondern Algorithmen. Das Datensammeln hilft nicht unbedingt beim Anpreisen von Waren. Um John Wanamaker, den ehemaligen Postminister der USA und Erfinder der modernen Werbung, zu zitieren: „Half the money I spend on advertising is wasted; the trouble is, I don’t know which half.“

Aber um das richtig verstehen zu können müsste man mal einen Schritt zurücktreten. Was sind Daten und wie verwandeln sich Daten in Ressourcen?

Nivine: Daten können allgemein als logisch geordnete Informationseinheiten bezeichnet werden, welche meist aus Codes bestehen und Symbole, Zahlen sowie Buchstaben kombinieren. Erst die IT-Systeme können diese Codes auswerten und somit die Daten verarbeiten.

Dabei ist zu betonen, dass es sich bei Debatten zum Thema Digitalisierung meistens um personenbezogene Daten handelt. Darunter werden einerseits sowohl sozioökonomische Daten als auch solche verstanden, welche individuelle Meinungen in Form von Beiträgen, Likes und Kommentaren darstellen. Außerdem fallen Verhaltensdaten, wie Suchanfragen und Metadaten, also Informationen über den Standort, unter den Begriff der personenbezogenen Daten.

Mithilfe von Datenanalysen und künstlicher Intelligenz werden sogenannte „prediktive Analysen“ durchgeführt, wodurch Vorhersagen über menschliches Verhalten getroffen werden können. Diese Vorhersagen haben zu einem sehr profitablen Markt geführt – vor allem für Plattformunternehmen wie Instagram und TikTok. Diese Unternehmen profitieren nicht nur davon, dass individuelles Verhalten vorherbestimmt werden kann, sondern auch davon, dass sich Gedanken und Verhalten aktiv beeinflussen lassen. Die Nutzer*innen werden zu transparenten Individuen, welche sich oftmals – ohne es zu wissen – in einer digitalen Sphäre befinden, welche aus ihnen Waren und Konsument*innen zugleich macht. Wie bereits Shoshana Zuboff 2018 in ihrem Buch „Überwachungskapitalismus“ beschreibt, werden menschliche Erfahrungen zu Rohstoffen für Verhaltensdaten, die es Unternehmen ermöglichen Profite zu generieren.

Dabei werden die Online-Welten von Algorithmen dominiert, indem sie die Plattformen strukturieren und deren Inhalte kuratieren. Besonders die Personalisierungsmechanismen gehen mit diversen Gefahren, wie Radikalisierungstendenzen, Überwachungsmechanismen, Intransparenz und Manipulation im Sinne der Wirtschaft einher.

Stefan: Bei Shoshana Zuboff, auf die du vorher schon hingewiesen hast, gibt es den Begriff des „Verhaltensmehrwerts“. Dieser wird im Fall von Google aus „surveillance asstes“ gewonnen aus denen „surveillance revenues“ erzielt werden, die in einem letzten Schritt in „surveillance capital“ verwandelt werden. Umso mehr die algorithmischen Maschinen an Verhaltensmehrwert konsumieren, umso präziser werden sie mit der zukünftigen Ausbeutung davon. Was macht das Datensammeln, Stichwort Big Data, mit uns und was ist algorithmische Personalisierung?

Nivine: Bei Algorithmen handelt es sich um programmierte Mechanismen, die mit Hilfe von Such- und Sortiervorschriften anhand von Datensätzen Interessen und Vorlieben erkennen können und daraus Wahrscheinlichkeiten und Folgerungen ableiten können. Genauer beschrieben sucht ein Algorithmus Datensätze und verknüpft diese miteinander, wodurch sich Entscheidungsempfehlungen ableiten lassen.

Das Ziel von Unternehmen ist es, mithilfe von Algorithmen einen individuellen Markt für die Nutzer*innen zu schaffen. Individuen erhalten personalisierte Inhalte, wodurch Unternehmen ihre Profite vergrößern können. Das Verhalten von Individuen wird also von Algorithmen verarbeitet, welche lernen die Interessen und Vorlieben der Nutzer*innen zu erkennen und kategorisieren. Ein besonders prägnantes Beispiel stellt der Algorithmus von TikTok dar, welcher die Startseite, die sogenannte „For You Page“ kuratiert. Hierbei haben Studien gezeigt, dass TikToks Algorithmus so leistungsfähig ist, dass er in der Lage ist, die Vorlieben und Interessen der Nutzer*innen in weniger als 40 Minuten zu erlernen.

Algorithmen strukturieren somit mithilfe von personenbezogenen Daten nicht nur die digitale Sphäre, sondern zunehmend das menschliche Leben als Ganzes.

Ela: 2021 wurde ein Dokument geleakt, das als „TikTok Algo 101“ betitelt war. Das „ultimative Ziel“ von TikTok ist die tägliche Vergrößerung der Zahl der aktiven Nutzer*innen. Deshalb hat man sich entschieden, den Videostrom auf zwei Messgrößen festzulegen: „Retention“, ob der Nutzer wiederkehrt, und „Verweildauer“. Ziel ist es die Nutzer*innen so lange wie möglich auf der Plattform zu halten, sie also im Endeffekt abhängig zu machen. Ich glaub man kann auch hier – wie bei YouTube, Facebook, etc. – davon ausgehen, dass man mit kontroversen Inhalten eher die Leute zum Dableiben anregt. Es geht eben um Profit.

Stefan: Was ist ein digitales Subjekt?

Nivine: Die digitale Sphäre, insbesondere soziale Medien, können als ein sozialer Raum verstanden werden. In diesen sozialen Räumen verbringen die Nutzer*innen ihre Zeit und interagieren mit der Plattform und anderen Nutzer*innen. In diesem Zusammenhang können digitale Subjekte identifiziert werden. Als digitales Subjekt kann eine Person beschrieben werden, die aus Daten, Profilen und anderen digitalen Aufzeichnungen besteht. Das digitale Subjekt unterscheidet sich vom lebenden Selbst, knüpft aber an die Subjektivität der lebenden Person an. Digitale Subjekte können als neue Formen der Subjektkonstruktion gesehen werden, die auf computergestützten Prozessen in der digitalen Sphäre basieren.

Stefan: Das klingt noch ein wenig abstrakt. Die Geschichte des Subjektbegriffs verweist auf den Herrschaftszusammenhang und heute besonders auf das Kapitalverhältnis. Der Subjektbegriff ist notwendig eng an die materiellen Verhältnisse gebunden oder er wird unklar. Zunächst einmal entsteht mit dem Subjekt auch die Herrschaft. Bei Althusser wird das Individuum zum Subjekt indem es in eine bestehende Struktur eingefügt wird. Michel Foucault bezeichnet es als Einfügung in eine Ordnung.

Aber es geht bei der „Subjektivierung“ auch um einen Wahrnehmungsprozess. Bei Marx erscheint das freie Individuum als Teilnehmendes am Produktionsprozess und Warentausch. Erst im Zusammenhang der bürgerlichen Gesellschaft kann sich das Individuum wirklich vereinzeln. Dabei verliert es aber zugleich die bewusste Wahrnehmung, die ein Sklave, Leibeigener oder Adliger noch haben musste: Dass seine gesellschaftliche Position von äußeren Zwängen mitbestimmt wird. Wir sind uns in dem Maß unseres gesellschaftlichen Zusammenhangs nicht mehr bewusst, indem wir scheinbar von den Zwängen der Gesellschaft befreit werden. Im digitalen Bereich erscheint dieser Sachverhalt noch diffuser.

Vielleicht wäre es also gut, diesen Subjektbegriff ein wenig zu konkretisieren.

Nivine: Der Subjektbegriff im Kontext des Digitalen ist sehr komplex, besonders im Kontext von Machtverhältnissen. Prinzipiell wird in den wissenschaftlichen Debatten nicht mehr zwischen der analogen und der digitalen Sphäre/Subjekt unterschieden. Mit dem digitalen Subjekt ist in diesem Kontext jedoch gemeint, dass die Plattformen Informationen über die Nutzer*innen in Form von Daten sammeln. Aus diesen Informationen werden Profile generiert, welche „digitale Subjekte“ darstellen. Diese Profile sind entscheidend für profitorientierte Strategien der jeweiligen Plattformunternehmen. Damit einher gehen asymmetrische Machtverhältnisse. Dies hat unterschiedliche Gründe. Ein entscheidender Grund ist jedoch die Informationsasymmetrie. Unternehmen wissen nahezu alles über die Nutzer*innen, für die Nutzer*innen sind die digitalen Infrastrukturen, besonders die Algorithmen, jedoch eine Black-Box. Besonders aus der Intransparenz der Algorithmen ergeben sich große Manipulationspotentiale im Sinne der Wirtschaft. Daher kann in diesem Rahmen sicherlich mit Foucault argumentiert werden, dass sich Subjekte „in eine Ordnung einfügen“. Besonders interessant ist in dieser Hinsicht, dass besonders soziale Medien rein von den Unternehmen kontrolliert werden und somit einen Raum darstellen, der rein wirtschaftsbasiert funktioniert.

Um die Fragen zu beantworten, wie genau die Subjektivierungsprozesse im Digitalen aussehen, was daran neu ist und inwieweit neue theoretische Ansätze dafür benötigt werden, braucht es weitere Forschung. Dies ist besonders wichtig, um zu verdeutlichen, dass es sich bei der digitalen Sphäre nicht um einen freien und neutralen Raum handelt, in dem unabhängig von der gesellschaftlichen Position und sozioökonomischen Situation „alles möglich ist“, wie es uns die Unternehmen weismachen möchten.

Stefan: Der Begriff des Profils stammt übrigens aus der Kriminologie. Ein Profiler ist einer, der einen Tatort analysiert und aus den dort auffindbaren Spuren ein Profil erstellt, aus dem dann abgeleitet werden kann, wie sich der Täter in Zukunft verhalten wird. Wo die nächste Tat stattfindet, oder was seine Motive für die Tat sein könnten. Das wir ein solches „Täterprofil“ mittlerweile freiwillig anlegen, ist eine interessante Entwicklung.

Ela: Das ist lustig, meine ersten Erfahrungen mit den sozialen Medien hab ich damals bei uboot.com gemacht, und bei fm4, da gabs diese Profilseiten. Da hat das angefangen mit dieser „Offenbarungswut“, aber ich denke, dass das auch viel damit zu tun hatte, dass die durchschnittlichen Nutzer*innen da zwischen 15 und 20 waren. Da hat man dann so Sachen ins Profil geschrieben wie Spitznamen und Songzitate, Buchzitate usw. Da hat das angefangen mit der Selbstkategorisierung, was sicher auch dem geschuldet war, dass man eben für andere Nutzer*innen gleich kurz und knackig Hinweise sähen wollte, auf welcher Seite man steht, was man für Musik hört, etc., da ging es eben auch um Abgrenzung, damit man nur mit solchen in Kontakt kommt, die für einen interessant sein könnten. Das ist ja bis heute so, nur dass das eben inzwischen von Algorithmen übernommen wird.

Stefan: Da entstehen Bubbles und Echo-Kammern. Selbstverstärkende Meinungsräume. Eine Meisterklasse in der möglichst verkürzten Meinungsäußerung ist TikTok. Was macht man auf TikTok?

Nivine: In den letzten Jahren hat die chinesische App „TikTok“ internationale Popularität erlangt. TikTok ist eine Kurzvideo-App, die Videos mit einer Länge zwischen 15 und 60 Sekunden enthält. Vor allem durch die Ausrichtung auf Jugendliche dominierte die App den Teenager-Markt und wurde zu einer viel genutzten App, mit mehr als 1 Milliarde Nutzer*innen. Zudem führte der Ausbruch von Covid-19 zu einem rasanten Anstieg der Nutzer*innenzahlen. Die App basiert auf dem schnellen Konsum von Videoinhalten und ermöglicht es den Nutzer*innen, eine Vielzahl von Funktionen wie Filter, Hashtags, Musik und Videobearbeitung zu nutzen, was die Erstellung von Inhalten aufgrund der einfachen Nutzung fördert. TikTok prägt mittlerweile die (Pop-)kultur, der jüngeren Generationen, durch virale Trends, wie Tanzvideos, Fashion-Trends, aber auch politische Diskurse.

Ela: Apropos Covid und Trends. Eine TikTokerin hat 2020 die Idee gehabt, man könnte sich ja als Symbol der „Einheit“ und „Rebellion“ gemeinsam ein Tattoo stechen lassen, ein Z, mit einer horizontalen Linie durch die Mitte, das für Generation Z stehen sollte. Dieser Trend kursierte unter dem Hashtag #GenZTattoo. Mehrere Userinnen kamen diesem Vorschlag gerne nach, bis andere begannen darauf hinzuweisen, dass das Symbol eine verdächtige Ähnlichkeit mit der Wolfsangel habe, die von einigen SS-Divisionen verwendet wurde, sowie noch heute als Symbol der Wehrhaftigkeit bei Rechtsextremen gern in Gebrauch ist. Nachdem die Starterin des Trends Todesdrohungen bekommen hat, hat sie ein Entschuldigungsvideo gepostet und Merchandising mit dem Z aus ihrem Etsy-Shop entfernt.

Ebenfalls 2020 haben K-Pop-Stans zahlreiche freie Tickets für Donald Trumps Rally in Tulsa, Oklahoma, reserviert, und damit potenziell die Zuschauerzahl beim Event dezimiert. Der Twitteraccount @TeamTrump hatte davor seine Anhängerinnen gebeten sich für freie Tickets bei der Rally zu registrieren, was von den K-Pop-Stans fleißig geteilt wurde und sich schließlich auch auf TikTok verbreitete. Die meisten Userinnen löschten ihre Tweets und TikToks nach einem Tag, um das Vorhaben geheim zu halten. Bei einer Kapazität von 19.000 Zuschauern wurden beim Event nur 6.200 Tickets vor Ort gescannt.

Stefan: Aber TikTok ist nicht nur politisch, sondern betrifft auch unser Selbstbild.

Ela: Eine Studie von 2022 mit 778 jungen amerikanischen Collegestudentinnen hat ergeben, dass die Nutzung von TikTok indirekt mit der Unzufriedenheit mit dem eigenen Körper zusammenhängt, dass diese den Vergleich des eigenen Aussehens nach oben hin und eine stärkere Überwachung des eigenen Körpers befördert, und das auch bei Nutzerinnen die ein hohes Maß an Medienkompetenz vorwiesen und Inhalte konsumierten, die Körperakzeptanz und Body Positivity behandelten. Die Ergebnisse deuten darauf hin, dass die regelmäßige und konsequente Nutzung von TikTok dem Körperbild von Frauen schaden kann, und dass Frauen mit einem höheren Maß an Körperakzeptanz und Kritikfähigkeit sowie an Medienkompetenz für diese negativen Auswirkungen am anfälligsten sein könnten.

Stefan: Die Medienwissenschaftlerin Stine Lomborg setzt sich mit den materiellen Grundlagen des digitalen Trackings auseinander. Web-Cookies oder sensorbasierte Technologien werden dazu genutzt digitale Funktionen und Dienste etwa auf Plattformen zu optimieren. Sie dienen aber auch der Überwachung der Generierung von Daten zum Trainieren von maschinellen Lernmodellen und anderen Entwicklungen in der KI.

Die potentiellen negativen Folgen des Trackings sind für sie äußerst dystopisch. Sie sagt, wir opfern das Recht, frei über unsere eigene Zukunft zu entscheiden. Gerade vulnerable Gruppen nehmen durch Tracking mehr Schaden als andere. Einwanderer werden ins Visier genommen und ihre Zukunft von den gewonnenen Erkenntnissen abhängig gemacht. Umfassende digitale Erfassung ist für Lombog eine infrastrukturelle Macht, die liberale Werte wie Gleichheit und Autonomie gefährdet und unsere Gesellschaften einem abstrakten Wandel unterzieht.

Wenn ich das höre, frage ich mich wovon wir ausgehen können. Sind diese liberalen Werte überhaupt so weit verwirklicht, dass wir uns über ihren Verlust Gedanken machen müssten? Oder anders gefragt können wir sie leben, wenn sich die Subjektivität in den digitalen Bereich verlagert? Und wie sieht das aus?

Daran anschließend: Ist eine digitale Subjektivierung wünschenswert? Wenn ja, wie wird sie sich auf die analogen Individuen auswirken. Wenn nein, was sind die Widerstandsmöglichkeiten dagegen? Und wie sinnvoll ist es überhaupt sich zu wehren?

Nivine: Ob eine digitale Subjektivierung wünschenswert ist oder nicht, ist eine berechtigte Frage. Die Tatsache ist jedoch, dass sich die Sozialisationsprozesse, besonders von jüngeren Generationen bereits zu einem Großteil in das Digitale verlagert haben. Es kann sogar von einer digitalen Vergesellschaftung gesprochen werden. Diese digitale Subjektivierung wird auch in Zukunft nicht verschwinden, sondern im Gegenteil immer ausgeprägter und relevanter werden

Die aufgeführten Trends und Debatten auf TikTok haben gezeigt, dass gesellschaftspolitische Debatten digital geführt werden können, dass Standards über Körper digital diskutiert werden, dass digitales Tracking an Ländergrenzen genutzt wird. Diese Entwicklungen sind größtenteils von Unternehmen, welche die Technologien und Infrastrukturen zur Verfügung stellen, dominiert. Die Frage ist jedoch, wie gehen wir damit um? Wie können Kinder und Jugendliche schulisch digitale Kompetenzen lernen, in denen sie über die Gefahren aufgeklärt und sensibilisiert werden? Was muss die Politik tun, um schnell auf Entwicklungen reagieren zu können? Und wie können die negativen Auswirkungen minimiert werden? All diese Fragen werden in den nächsten Jahren geklärt werden müssen.

Stefan: Die Frage ist sicherlich auch, was machen wir mit Körperbildern, die gar nicht mehr von menschlichen Körpern geprägt werden, sondern von Deepfakes. Ich sehe in meiner Facebook-Timeline immer öfter so genannte Celebrity Deepfakes. Wo also die Gesichter von berühmten Schauspielerinnen oder Sportlerinnen (fast immer sind es übrigens Frauen) auf meist vereinheitlicht überproportionierte Körper montiert werden. Und von den Kommentaren kann ich sagen, dass tausende Männer bereit sind diese Körperbilder sofort ohne Ironie zu akzeptieren.

Ela: Ja, aber dass es da irgendwie einen Hang gibt unrealistisches Zeug aus dem Internet gut zu finden, ist ja auch nichts neues, das kennen wir ja schon von Pornografie. Und das sind dann wahrscheinlich dieselben, die in Pseudodiskussionen auf Social Media behaupten, dass Body Positivity so überhandnimmt, und dass man über Frauenkörper gar nichts mehr Negatives sagen darf, während man sich über Leonardo DiCaprios Dad Bod ganz offen lustig machen darf. Dann frag ich mich aber, wann haben wir je aufgehört uns über Frauenkörper lustig zu machen? Weil es jetzt ein paar Hansln gibt, die versuchen mit übertriebener Body Positivity dagegen zu steuern, kann man doch noch lange nicht davon reden, dass das irgendwie ein gesamtgesellschaftlicher Trend ist, dass Frauen öffentlich fett sein dürfen und dass es Konsequenzen für Bullys gibt.

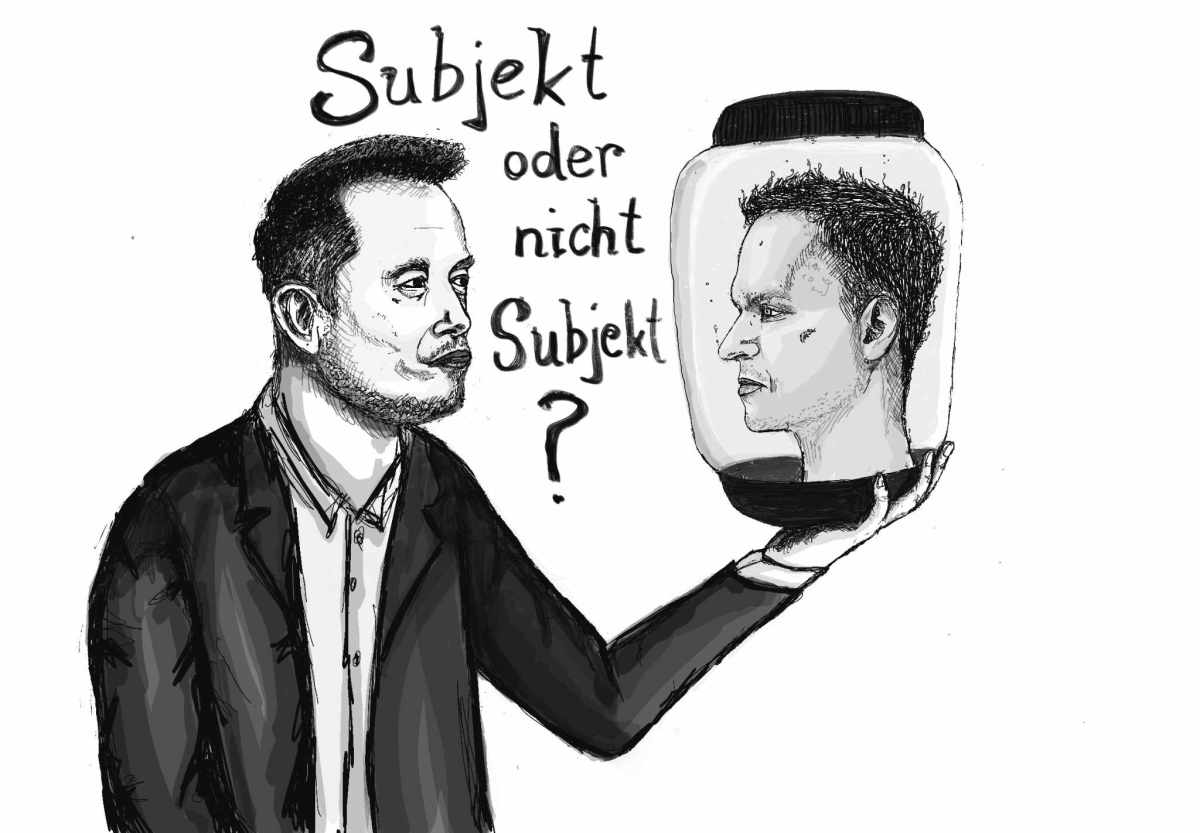

Stefan: Das Subjekt hängt im Netz seiner eigenen Klischees und der Imperative, die ihm das Kapitalverhältnis ständig vorhält. Davon kann sicherlich auch Elon Musk ein Lied singen, wenn er sich angesichts des gefrorenen Kopfes von Peter Thiel fragt: „Subjekt oder nicht Subjekt?“